في عالم يزداد فيه الاعتماد على الذكاء الاصطناعي، تبرز التحديات الأمنية بشكل متزايد، مما يتطلب حلولاً مبتكرة لضمان الأمان والثقة في هذه النظم المتقدمة. هنا تأتي منصة بيلار سيكيوريتي لتقديم رؤية شاملة تهدف إلى حماية دورة حياة تطوير ونشر البرمجيات بالكامل.

النهج الشامل للأمن السيبراني في الذكاء الاصطناعي

تتبنى منصة بيلار سيكيوريتي نهجاً شاملاً يهدف إلى تحسين الأمان في نظم الذكاء الاصطناعي من مرحلة التخطيط المسبق وحتى مرحلة التشغيل. هذا النهج يتيح رؤية شاملة لوضع الأمان في التطبيقات، مما يعزز تنفيذ الذكاء الاصطناعي بشكل آمن.

تأسست بيلار سيكيوريتي على يد خبراء في المجالين الهجومي والدفاعي، حيث يجمع المؤسسون بين خبرات واسعة في العمليات الأمنية والهجمات السيبرانية، مما يتيح لهم تطوير حلول مبتكرة لمواجهة التهديدات المعقدة.

فلسفة المنصة: دائرة الأمان المتكاملة

تختلف بيلار سيكيوريتي عن النظم التقليدية بفضل نهجها التكاملي، حيث تعمل كل مكون من مكونات المنصة على إثراء المكونات الأخرى، مما يخلق حلقة تغذية عكسية تمكن الأمان من التكيف مع كل حالة استخدام فريدة.

من خلال إدارة الوضع الأمني (Security Posture Management)، توفر المنصة رؤى قيمة تستند إلى بيانات الاكتشاف، في حين تبني الحواجز التكيفية المستخدمة خلال وقت التشغيل على تحليلات نمذجة التهديدات والاختبارات الأمنية المتقدمة (Red Teaming). هذا النهج الديناميكي يضمن تحسين الدفاعات الحية عند اكتشاف ثغرات جديدة.

العمل من خلال بيئة عمل الذكاء الاصطناعي: تعزيز الأمان من البداية

يبدأ عمل بيلار سيكيوريتي في ما تسميه بيئة عمل الذكاء الاصطناعي، حيث يمكن لفِرق الأمان اختبار حالات الاستخدام المحتملة والتخطيط للتهديدات المحتملة قبل كتابة أي شيفرة. هذا المرحلة الأساسية تساعد المؤسسات على مواءمة نظم الذكاء الاصطناعي مع السياسات المؤسسية والمتطلبات التنظيمية.

توجه المنصة المطورين وفِرق الأمان من خلال عملية نمذجة التهديدات المنظمة، مما يساعد على تحديد السيناريوهات الهجومية المحتملة الخاصة بحالة استخدام التطبيق. تُستخدم أطر محددة مثل STRIDE وISO وMITRE ATLAS وOWASP Top Ten for LLMs لدعم هذه العملية.

التحديات الخاصة بالتوسع في الذكاء الاصطناعي

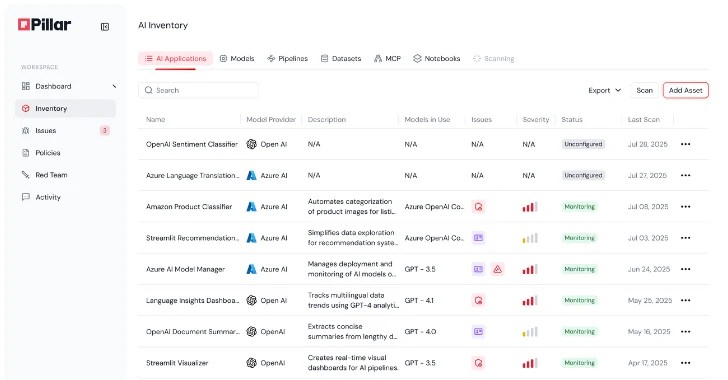

يُشكل التوسع في استخدام الذكاء الاصطناعي تحدياً معقداً لفِرق الأمان، حيث تفتقر الفِرق إلى رؤية شاملة حول كيفية وأماكن استخدام الذكاء الاصطناعي في بيئات التطوير والإنتاج. هنا تتدخل بيلار سيكيوريتي لتوفير حلول تتجاوز خطوط أنابيب التكامل المستمر (CI/CD) ودورة حياة تطوير البرمجيات التقليدية (SDLC).

من خلال التكامل المباشر مع مستودعات الشيفرة ومنصات البيانات وأطر الذكاء الاصطناعي/التعلم الآلي (AI/ML) وبيئات العمل المحلية، يمكن للمنصة اكتشاف وفهرسة كل الأصول المتعلقة بالذكاء الاصطناعي تلقائياً داخل المنظمة. هذا التوجه يتيح تشكيل سياسة أمان مؤسسية واضحة، وفهم أعمق لحالات استخدام الأعمال.

إدارة المخاطر الأمنية للذكاء الاصطناعي (AI-SPM)

بعد تحديد جميع الأصول المتعلقة بالذكاء الاصطناعي، تقوم بيلار بتحليل الوضع الأمني لكل منها. يعتمد AI Security Posture Management (AI-SPM) على تحليل ثابت وديناميكي للأصول والمكونات المرتبطة بها، مما يساعد في الكشف عن المخاطر مثل سلاسل التوريد وتسمم البيانات ومستويات المخاطر في النماذج والمطالبات والأدوات.

تساعد هذه الرؤى الفِرق في تحديد الأولويات والتهديدات، حيث تقدم تصوراً دقيقاً لكيفية تحرك الجهات الفاعلة في النظام. بدلاً من الانتظار حتى يكتمل بناء التطبيق، تعزز بيلار نهج الثقة من التصميم (trust-by-design)، مما يتيح لفِرق الذكاء الاصطناعي اختبار النظم أثناء البناء.

الاختبارات الأمنية وفريق الاختبارات الحمراء (Red Teaming)

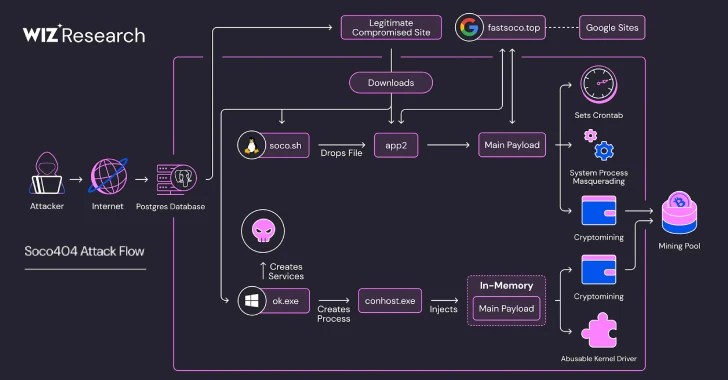

تشغل المنصة هجمات محاكاة مخصصة لحالات استخدام نظام الذكاء الاصطناعي، باستخدام تقنيات مثل الحقن في المطالبات (prompt injections) والهجمات المتقدمة التي تستهدف ثغرات منطق الأعمال. تساعد هذه الأنشطة في تحديد ما إذا كان يمكن التحكم في وكيل الذكاء الاصطناعي لإعطاء استردادات غير مصرح بها أو تسريب البيانات الحساسة.

تقدم بيلار أيضاً قدرة فريدة من نوعها من خلال الاختبارات الحمراء لاستخدام الأدوات. تدمج المنصة نمذجة التهديدات مع تفعيل الأدوات بشكل ديناميكي، لاختبار كيفية استغلال سلاسل الأدوات واستدعاءات واجهات برمجة التطبيقات (APIs) في سيناريوهات هجوم واقعية. يكشف هذا النهج المتقدم عن الثغرات التي لا يمكن كشفها بطرق الاختبار التقليدية.

بالنسبة للمؤسسات التي تستخدم تطبيقات الذكاء الاصطناعي من جهات خارجية أو التطبيقات المتضمنة مثل مساعدي البرمجة (copilots) أو الدردشة المخصصة حيث لا يمكنها الوصول إلى الشيفرة الأساسية، تقدم بيلار اختبارات حمراء مستهدفة تعتمد على البلاك بوكس. باستخدام رابط ويب وبيانات اعتماد فقط، يمكن لوكلاء بيلار العدائيين إجراء اختبارات إجهاد لأي تطبيق ذكاء اصطناعي متاح داخلياً أو خارجياً.

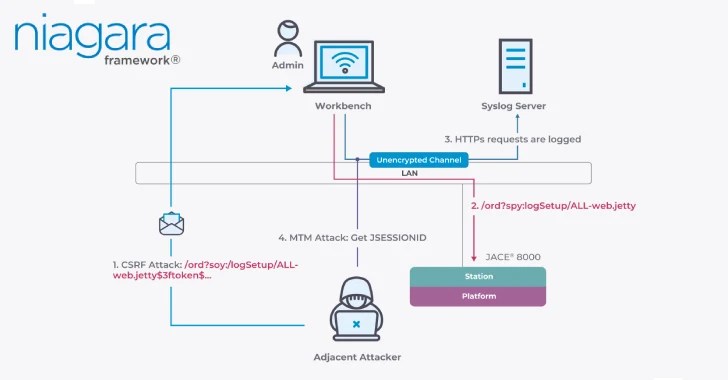

الحواجز التكيفية: فرض السياسات في وقت التشغيل

مع انتقال تطبيقات الذكاء الاصطناعي إلى الإنتاج، تصبح الحاجة إلى ضوابط أمان حية أمراً ضرورياً. تقدم بيلار نظاماً من الحواجز التكيفية التي تراقب المدخلات والمخرجات خلال وقت التشغيل، مصممة لفرض السياسات الأمنية دون التأثير على أداء التطبيق.

هذه الحواجز ليست مجموعة من القواعد الثابتة أو جدران الحماية التقليدية، بل هي نموذجية، ومركزة على التطبيقات وتتطور باستمرار. تستند إلى بيانات التليمترية والرؤى المستمدة من الاختبارات الحمراء وتغذيات معلومات التهديدات، مما يسمح للمنصة بالتكيف في الوقت الحقيقي مع تقنيات الهجوم الناشئة.

أثناء العرض التوضيحي، رأينا كيف يمكن ضبط الحواجز بدقة لمنع سوء الاستخدام مثل الإخراج غير المصرح به للبيانات أو الإجراءات غير المقصودة، مع الحفاظ على السلوك المقصود للذكاء الاصطناعي. يمكن للمؤسسات فرض سياسات الذكاء الاصطناعي وقواعد السلوك المخصصة عبر التطبيقات بثقة أن الأمن والوظائف سيتعايشان.

الصندوق الرملي: احتواء المخاطر المتعلقة بالوكيل الذكي

إحدى المخاوف الحرجة هي الوكالة المفرطة. عندما يمكن للوكلاء تنفيذ إجراءات تتجاوز نطاقاتهم المقصودة، قد يؤدي ذلك إلى عواقب غير مقصودة. تعالج بيلار هذا الأمر خلال مرحلة التشغيل من خلال صندوق آمن.

تعمل وكلاء الذكاء الاصطناعي، بما في ذلك النظم المتقدمة مثل وكلاء البرمجة وخوادم MCP، داخل بيئات محكمة التحكم. تطبق هذه النظم المعزولة مبادئ الثقة الصفرية لفصل الوكلاء عن البنية التحتية الحساسة والبيانات الحساسة، مع تمكينهم من العمل بشكل منتج. يتم احتواء أي سلوك غير متوقع أو ضار دون التأثير على النظام الأكبر.

التليمترية للذكاء الاصطناعي: من المطالبة إلى الإجراء

لا يتوقف الأمان بمجرد تشغيل التطبيق. خلال دورة الحياة، تجمع بيلار باستمرار بيانات التليمترية عبر كامل حزمة الذكاء الاصطناعي. يتم تسجيل المطالبات وإجراءات الوكلاء واستدعاءات الأدوات والبيانات السياقية في الوقت الحقيقي.

توفر هذه التليمترية التحقيقات العميقة وتتبع الامتثال. يمكن لفِرق الأمان تتبع الحوادث من الأعراض إلى السبب الجذري، وفهم السلوك الشاذ، وضمان عمل نظم الذكاء الاصطناعي ضمن الحدود السياسية.

الخلاصة

تتميز بيلار عن غيرها من خلال الجمع بين العمق الفني والبصيرة الواقعية والمرونة على مستوى المؤسسة. تأسست على يد قادة في كل من الأمن الهجومي والدفاعي، الفريق لديه سجل حافل في الأبحاث الريادية التي كشفت عن ثغرات حرجة وأنتجت تقارير هجوم واقعية مفصلة. هذه الخبرة مدمجة في المنصة في كل مستوى.

تأخذ بيلار نهجاً شاملاً لأمن الذكاء الاصطناعي يمتد إلى ما بعد خط أنابيب التكامل المستمر. من خلال دمج الأمان في مراحل التخطيط والبرمجة والاتصال المباشر بمستودعات الشيفرة ومنصات البيانات والبيئات المحلية، تكسب بيلار رؤية مبكرة وعميقة في النظم التي يتم بناؤها. هذا السياق يمكن من التحليل الدقيق للمخاطر واختبارات الفريق الأحمر المستهدفة بشكل كبير مع تقدم التطوير.

المنصة مدعومة بأكبر تدفق معلومات تهديدات الذكاء الاصطناعي في الصناعة، محسن بواسطة أكثر من 10 مليون تفاعل واقعي. تغذي هذه البيانات التهديدية الاختبار الآلي، ونمذجة المخاطر، والدفاعات التكيفية التي تتطور مع مشهد التهديدات.

أخيراً، بيلار مصممة للتوزيع المرن. يمكن تشغيلها في أماكن العمل، في البيئات الهجينة، أو بشكل كامل في السحابة، مما يمنح العملاء السيطرة الكاملة على البيانات الحساسة والمطالبات والنماذج المملوكة لهم. هذه ميزة حاسمة للصناعات المنظمة حيث الإقامة الأمنية والبيانات ذات أهمية قصوى.

معاً، تجعل هذه القدرات بيلار أساساً قوياً وعملياً لاعتماد الذكاء الاصطناعي بأمان على نطاق واسع، مما يساعد المؤسسات المبتكرة على إدارة المخاطر الخاصة بالذكاء الاصطناعي واكتساب الثقة في نظمهم.

شاركنا رأيك بتعليق