في خطوة جريئة تكشف عن تعقيدات التهديدات الحديثة التي تواجه الأمن السيبراني، أعلنت شركة أوبن إيه آي (OpenAI) عن حظر مجموعة من الحسابات التي استغلت أداتها الشهيرة شات جي بي تي (ChatGPT) لتطوير أداة مراقبة مشتبه بأنها تستخدم الذكاء الاصطناعي. تتطلب هذه الحالة دراسة معمقة لفهم كيفية استغلال الذكاء الاصطناعي في العمليات الخبيثة وإجراءات مواجهتها.

تحليل مفصل وسياق تاريخي

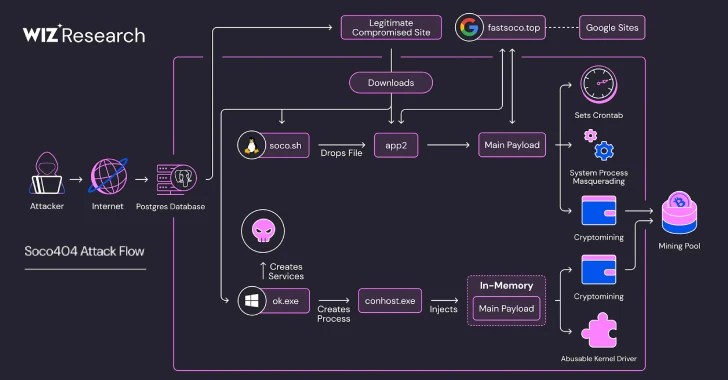

تشير التقارير إلى أن الأداة التي تم حظرها قد تكون نشأت من الصين، وهي مدعومة بنماذج لاما (Llama) التابعة لشركة ميتا (Meta). استخدمت هذه النماذج لتوليد أوصاف مفصلة وتحليل مستندات لنظام قادر على جمع البيانات في الوقت الحقيقي وتقديم تقارير حول احتجاجات مناهضة للصين في الغرب، ثم مشاركة هذه المعلومات مع السلطات الصينية. أطلق على هذه الحملة اسم “Peer Review” بسبب سلوك الشبكة في الترويج والتقييم لأدوات المراقبة.

ومن بين المنصات المستهدفة، كانت هناك شبكات التواصل الاجتماعي الشهيرة مثل فيسبوك (Facebook)، إكس (X)، يوتيوب (YouTube)، إنستغرام (Instagram)، تليجرام (Telegram)، وريدت (Reddit). في إحدى الحالات التي رصدتها الشركة، استخدم الفاعلون شات جي بي تي لتصحيح وتحسين شفرة المصدر الخاصة بالبرنامج المراقب، والذي يُعرف باسم “Qianyue Overseas Public Opinion AI Assistant”.

التداعيات الأمنية والمخاطر

يعكس هذا التطور المخاطر المتزايدة لاستخدام الذكاء الاصطناعي في تسهيل حملات التضليل السيبراني والعمليات الخبيثة الأخرى. تبرز هذه الحوادث كيف يمكن للذكاء الاصطناعي أن يصبح سلاحًا قويًا في يد الجهات الفاعلة الخبيثة، خاصة في مجالات مثل المراقبة والتأثير على الرأي العام.

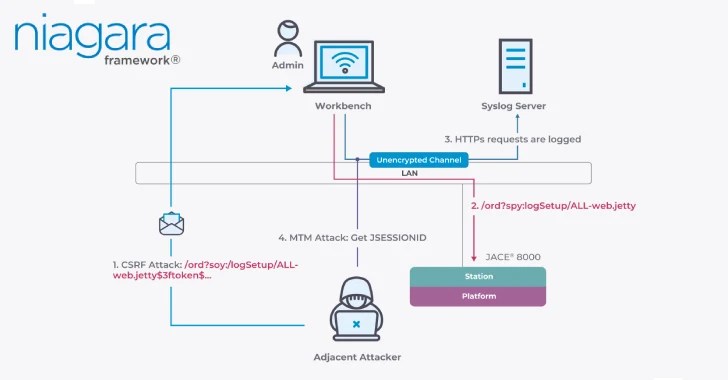

لا يمكن النظر إلى هذه الحادثة بمعزل عن غيرها. فعلى سبيل المثال، كشف فريق استخبارات التهديدات من جوجل (Google Threat Intelligence Group) في الشهر الماضي عن استخدام 57 جهة تهديد مختلفة لأداتها Gemini AI chatbot لتحسين مراحل متعددة من دورة الهجوم وتنفيذ الأبحاث في الأحداث الجارية، أو للقيام بإنشاء المحتوى والترجمة والتوطين.

رؤى الخبراء والتوجهات المستقبلية

يؤكد الخبراء على أهمية التعاون بين الشركات المعنية بالذكاء الاصطناعي ومنصات التواصل الاجتماعي والباحثين في المصادر المفتوحة للكشف عن الجهات الفاعلة الخبيثة وفرض الإجراءات القانونية. إن البصيرة الفريدة التي يمكن أن تقدمها شركات الذكاء الاصطناعي بشأن الجهات الفاعلة تهدد الأمن السيبراني، وتفتح طرقًا جديدة للكشف والإنفاذ.

دعوة للتفكير والنقاش

في ضوء هذه التطورات، يبقى السؤال المهم: كيف يمكن للمجتمع الدولي أن يوازن بين فوائد الذكاء الاصطناعي وتهديداته المتزايدة؟ وكيف يمكن تعزيز التعاون بين مختلف الأطراف للحد من استغلال التكنولوجيا في الأغراض الخبيثة؟

لمتابعة المزيد من المقالات الحصرية، يمكنكم متابعتنا على إكس وفيسبوك.

شاركنا رأيك بتعليق