أعلنت هيئة حماية البيانات الإيطالية عن حظر خدمات شركة الذكاء الاصطناعي الصينية ديب سيك (DeepSeek) داخل البلاد، مشيرة إلى نقص المعلومات حول كيفية استخدام الشركة لبيانات المستخدمين الشخصية. تأتي هذه الخطوة بعد أن أرسلت الهيئة، المعروفة باسم “غارانتي” (Garante)، سلسلة من الأسئلة إلى شركة ديب سيك تطلب فيها توضيح ممارساتها في التعامل مع البيانات ومصادر تدريبها.

تحليل مفصل وسياق تاريخي

طالبت الهيئة بمعرفة البيانات الشخصية التي يتم جمعها بواسطة منصة الويب والتطبيق المحمول للشركة، ومن أي مصادر، ولأي غايات، وعلى أي أسس قانونية، وما إذا كانت تخزن في الصين. في بيان صادر بتاريخ 30 يناير 2025، ذكرت “غارانتي” أنها اتخذت قرارها بعد الحصول على معلومات وصفتها بأنها “غير كافية بالمرة” من ديب سيك.

أشارت الكيانات المسؤولة عن الخدمة، وهما “هانغتشو ديب سيك للذكاء الاصطناعي” و”بكين ديب سيك للذكاء الاصطناعي”، إلى أنها لا تعمل في إيطاليا وأن التشريعات الأوروبية لا تنطبق عليها. بناءً على ذلك، أعلنت الهيئة عن حظر الوصول إلى ديب سيك بشكل فوري وفتح تحقيق في الوقت ذاته.

التأثير والتحديات الأمنية

في عام 2023، فرضت هيئة حماية البيانات حظرًا مؤقتًا على “شات جي بي تي” (ChatGPT) التابعة لأوبن إيه آي (OpenAI)، ولكن تم رفع الحظر في أبريل بعد معالجة الشركة لمخاوف الخصوصية. لاحقًا، تم تغريم أوبن إيه آي بمبلغ 15 مليون يورو بسبب كيفية تعاملها مع البيانات الشخصية.

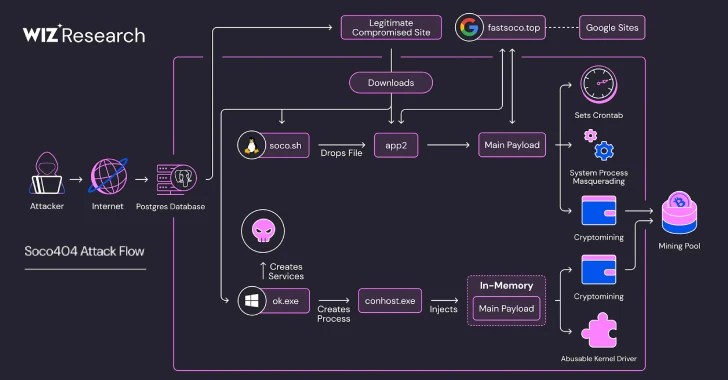

تأتي أخبار حظر ديب سيك في وقت كانت الشركة تشهد فيه ازديادًا في شعبيتها، حيث تدفق الملايين لاستخدام الخدمة، مما جعل تطبيقاتها تتصدر قوائم التحميل. إلى جانب ذلك، تعرضت لهجمات ضارة كبيرة، ولفتت انتباه المشرعين والمنظمين بسبب سياساتها المتعلقة بالخصوصية والرقابة المتماشية مع الصين، والدعاية، والمخاوف الأمنية الوطنية التي قد تطرحها. نفذت الشركة إصلاحًا في 31 يناير لمعالجة الهجمات على خدماتها.

رؤى الخبراء والتوسعات

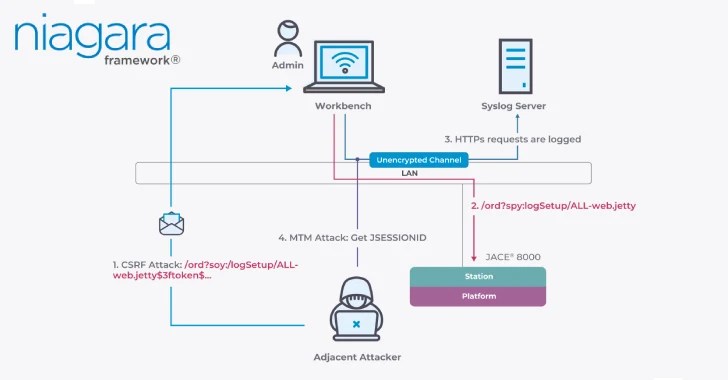

تواجه ديب سيك تحديات إضافية حيث تم اكتشاف أن نماذجها اللغوية الكبيرة (LLM) عرضة لتقنيات “الهروب من السجون” مثل “كريسيندو” (Crescendo) و”باد ليكرت جادج” (Bad Likert Judge) و”ديستبتيب ديلايت” (Deceptive Delight) و”دو أني ثينج ناو” (Do Anything Now) و”إيفيل بوت” (EvilBOT)، مما يسمح للمهاجمين بإنشاء محتوى ضار أو محظور.

قالت “بالو ألتو نتوركس” (Palo Alto Networks) في تقرير صدر يوم الخميس: “بينما كانت ردود ديب سيك الأولية تبدو بريئة، في العديد من الحالات، كشفت المطالبات المتابعة المصاغة بعناية عن ضعف هذه التدابير الأولية. قدم نموذج LLM تعليمات ضارة مفصلة للغاية، مما يوضح إمكانية تسليح هذه النماذج البريئة ظاهريًا لأغراض خبيثة.”

الإطار القانوني والمعايير الصناعية

تم تقييم نموذج التفكير الخاص بديب سيك، ديب سيك-آر1 (DeepSeek-R1)، بواسطة شركة أمن الذكاء الاصطناعي “هيدن لاير” (HiddenLayer)، حيث تم اكتشاف أنه ليس فقط عرضة لحقن المطالبات بل أيضًا أن سلسلة التفكير (Chain-of-Thought) الخاصة به يمكن أن تؤدي إلى تسرب معلومات غير مقصود.

في تطور مثير، ذكرت الشركة أن النموذج كشف أيضًا عن حالات متعددة تشير إلى أن بيانات أوبن إيه آي قد تم دمجها، مما يثير مخاوف أخلاقية وقانونية حول مصادر البيانات وأصالة النموذج.

المشاركة والنقاش

ما رأيك في تأثير حظر خدمات الذكاء الاصطناعي الدولية على الابتكار والأمن السيبراني؟ هل تشكل هذه الخطوات حماية ضرورية لخصوصية المستخدمين أم عقبة أمام التطور التكنولوجي؟ شاركنا رأيك عبر تويتر وفيسبوك.

شاركنا رأيك بتعليق