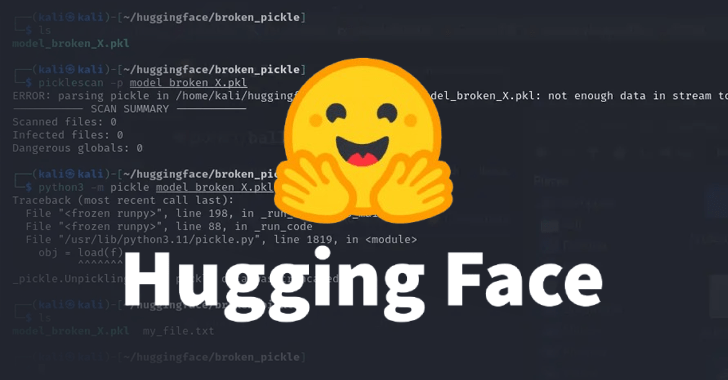

في تطور مثير في عالم الأمن السيبراني، اكتشف الباحثون نماذج تعلم آلي ضارة على منصة هاجينغ فيس (Hugging Face) تستخدم تقنية غير تقليدية تعتمد على ملفات بيكل (Pickle) “المكسورة” لتفادي الكشف. وتعتبر هذه التقنية، التي أطلق عليها اسم “nullifAI”، محاولة واضحة لتجاوز الإجراءات الأمنية الموجودة التي تهدف إلى تحديد النماذج الخبيثة.

تفاصيل الاكتشاف وأهميته في الأمن السيبراني

وفقًا لتقرير الباحث كارلو زانكي من شركة ReversingLabs، فإن ملفات بيكل المستخرجة من أرشيفات بايتورتش (PyTorch) كشفت عن محتوى بايثون خبيث في بداية الملف. في كلا الحالتين، كان الحمولة الضارة عبارة عن اتصال عكسي (Reverse Shell) يتصل بعنوان IP محدد مسبقًا، مما يشير إلى الطبيعة المتطورة لهذه الهجمات.

الملفات التي تم اكتشافها موجودة في مستودعات هاجينغ فيس التالية:

- glockr1/ballr7

- who-r-u0000/0000000000000000000000000000000000000

يُعتقد أن هذه النماذج هي أكثر من مجرد إثبات للمفهوم (Proof-of-Concept) بدلاً من هجوم نشط على سلسلة التوريد. ومع ذلك، فإن استخدام تنسيق بيكل للتسلسل، الذي يُعتبر شائعاً في توزيع نماذج التعلم الآلي، قد أثبت مرارًا أنه يشكل خطرًا أمنيًا، لأنه يوفر طرقًا لتنفيذ تعليمات برمجية عشوائية بمجرد تحميلها وإعادة تسلسلها.

التحديات والتهديدات الأمنية المرتبطة بالنماذج المكتشفة

النماذج المكتشفة مخزنة بتنسيق بايتورتش، الذي ليس سوى ملف بيكل مضغوط. وبينما يستخدم بايتورتش تنسيق ZIP للضغط بشكل افتراضي، تم العثور على النماذج المعنية مضغوطة باستخدام تنسيق 7z، مما سمح لها بالمرور دون الكشف عنها بواسطة أداة Picklescan التي يستخدمها هاجينغ فيس لاكتشاف ملفات بيكل المشبوهة.

أظهرت التحليلات أن هذه الملفات “المكسورة” يمكنها أن تتسلسل جزئيًا بسبب التناقض بين Picklescan وكيفية عمل إعادة التسلسل، مما يؤدي إلى تنفيذ التعليمات البرمجية الضارة على الرغم من إظهار الأداة لرسالة خطأ. ومنذ ذلك الحين، تم تحديث الأداة لتصحيح هذا الخطأ.

تداعيات الاكتشاف والخطوات المستقبلية

يشير هذا الاكتشاف إلى الحاجة الملحة لتعزيز الإجراءات الأمنية حول نماذج التعلم الآلي، خاصة مع زيادة استخدامها في القطاعات الحيوية مثل المالية والرعاية الصحية والحكومية. إن فهم كيفية استغلال هذه النماذج يُعتبر خطوة حاسمة في حماية الأنظمة الحساسة من الاختراقات المستقبلية.

ما رأيك في التحديات الأمنية المستقبلية التي يمكن أن تواجهها نماذج التعلم الآلي؟ شاركنا رأيك على وسائل التواصل الاجتماعي عبر Facebook وX (Twitter) باستخدام الهاشتاج #CyberSecurityTrends.

شاركنا رأيك بتعليق